本周六开班 | CAISP人工智能安全认证专家

人工智能(AI)正以前所未有的速度渗透到现代企业的各个角落。从Copilot智能助手显著提升员工生产力,到AI代理提供全天候的一线客户支持,再到大语言模型(LLM)帮助企业从海量数据中提取深层次商业洞见,AI的应用前景一片光明。

然而,这枚硬币的另一面却潜藏着巨大的风险。一旦被释放,AI就像一个饥饿的“吃豆人”,贪婪地扫描和分析其能触及的一切数据。如果AI在不该出现的地方暴露了企业的关键核心数据,那么一切都将“游戏结束”。数据一旦泄露,便无法挽回。

更令人担忧的是,AI并非唯一的威胁。日益庞杂的云端环境、未经授权的“影子应用”、多因素认证(MFA)的缺失以及其他潜在风险,共同构成了一枚针对企业数据的“滴答作响的定时炸弹”。任何缺乏适当数据安全措施的组织,都有可能面临敏感信息灾难性泄露的风险。

Varonis报告:量化AI的数据风险

为了量化AI对数据风险的具体影响,全球数据安全领导者Varonis发布了《2025年数据安全状况报告:量化AI对数据风险的影响》。该报告并非基于问卷调查,而是通过对全球1000个真实IT环境进行数据风险评估,提供了关于风险的实证证据。

研究人员深入分析了两大类型的AI数据风险:

- 人机风险(Human-to-Machine Risk): 这类风险主要关注AI助手和代理能够访问或因单一提示(prompt)而暴露多少敏感数据。这些数据可能包括员工薪资、产品研发资料、核心源代码等,一旦泄露,后果不堪设想。

- 机机风险(Machine-to-Machine Risk): 这类风险聚焦于被用来“喂养”大语言模型的数据其本身的完整性和安全性。错误或被污染的数据可能引发灾难性后果。例如,被篡改的临床试验数据可能会彻底破坏突破性药物的研发进程;而恶意行为者更可能悄无声息地将恶意代码植入到大语言模型中,使其成为潜在的攻击工具。

没有企业能幸免

Varonis的分析结果令人震惊:在接受评估的1000家组织中,没有一家能够完全防范数据泄露,也没有一家为AI时代的到来做好了充分准备。

报告中的关键数据揭示了普遍存在的安全漏洞:

- 99%的组织存在敏感数据被不必要地暴露给AI工具的风险。

- 90%的敏感云数据(包括AI训练数据)处于开放状态,可被AI工具轻易访问。

- 98%的组织环境中存在未经审核的应用程序,包括所谓的“影子AI”。

- 七分之一(约14%)的组织未能在其SaaS和多云环境中全面强制执行多因素认证(MFA)。

- 88%的组织环境中潜伏着“幽灵用户”(已离职或无效的账户),这些账户是潜在的安全后门。

Varonis副总裁Matt Radolec表示:“AI正在将数据风险问题暴露在聚光灯下。许多组织在没有完全理解其权限模型的情况下就仓促采用AI,这意味着数据可能会被无意中暴露给内部员工、其他用户,甚至是对外暴露。”

未雨绸缪:企业如何应对

尽管前景严峻,但企业仍可采取主动措施来为AI时代的数据安全保驾护航。该报告提出了三项核心建议:

- 缩小爆炸半径:主动减少攻击者在窃取身份后可能造成的损害范围。这意味着实施最小权限原则,确保用户和AI工具只能访问其绝对必要的数据。

- 持续监控与自动化:对数据进行持续监控,实现访问治理和安全态势管理的自动化,并采用主动的威胁检测技术,以便在威胁造成实际损害前发现并阻止它。

- 以AI对抗风险:IT和安全团队自身也可以利用AI和自动化技术来修复问题和弥补漏洞。通过自动化工具,可以更高效地管理庞大的数据权限,并对安全警报做出快速响应。

Varonis的分析明确指出,绝大多数组织,无论其规模或行业,都在努力维持稳健的数据安全实践。随着AI技术的不断演进,将数据保护置于优先地位并实施有效的安全措施,已成为所有企业在AI时代生存和发展的关键。

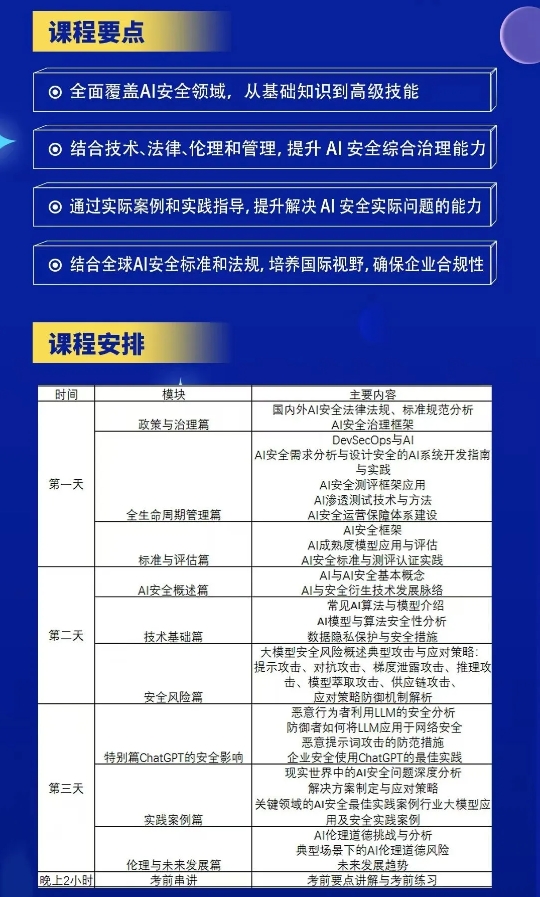

由CSA(国际云安全联盟)推出的CAISP人工智能安全认证专家课程内容全面覆盖技术细节、政策法规以及安全标准,并通过丰富的实践案例分析,确保学员能够深入掌握人工智能安全领域的专业知识,该认证课程内容符合企业对AI安全人才的需求。

CAISP

人工智能安全认证专家

CAISP课程专注于理解人工智能安全的治理与管理环境,学习 AI 安全的术语与安全目标、针对于算法、模型以及数据安全和隐私进行学习,全面提升对 AI 安全风险的识别、评估与测评等实战化能力;课程还涵盖了 AI 安全的国内与国外的法律法规框架,并通过实际案例,探讨如何在组织中实施 AI 安全;此外,学员还将具体学习如何应对 AI 安全的风险与挑战,包括应对数据投毒、对抗性攻击和供应链威胁等多种安全挑战。

承制CAISP培训班

承制科技作为CSA授权培训机构,已成功举办了多期CAISP认证培训班,并且有不少学员已经申请并通过考试。

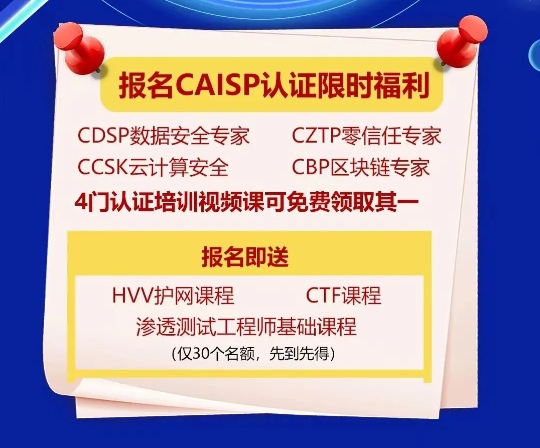

承制将继续提升CAISP教学服务质量,并将在7月12日(本周六)举办下一期CAISP直播培训班,现在报名可免费选择一门CSA认证课程培训视频。

CAISP课程收益

对个人价值

- 技术与实战结合:通过实际案例和实践指导,提升解决实际问题的能力,将理论知识转化为实际操作技能,促进个人技术成长与实操经验积累。

- 国际视野拓展:结合全球AI安全标准和法规的学习,帮助个人形成国际化的视角,提升在跨国企业或国际合作项目中的适应性和价值。

- 法律法规精通:熟悉国内外政策法规,增强伦理道德意识,为个人职业生涯树立合规操作的基石,降低法律风险。

- 职业发展加速:获得CAISP认证,证明个人在AI安全领域的专业地位,有利于职业晋升、薪资增长以及更广泛的职业选择。

- 安全思维培养:从设计到运营的全周期安全管理能力,使得个人能够在任何涉及AI安全的项目中发挥关键作用,成为企业不可或缺的安全专家。

对企业价值

- 合规性保障:员工熟悉国内外AI安全政策和伦理道德,帮助企业建立合规的安全管理体系,避免法律风险,提升企业形象和社会责任感。

- 成本效率优化:通过DevSecOps的集成,提高AI开发流程的安全性与效率,减少因安全问题导致的修复成本和时间延误。

- 创新能力提升:在大语言模型安全实践与ChatGPT安全最佳实践的指导下,企业能够安全高效地利用最新技术,推动产品和服务创新。

- 安全化构建:培养员工在全生命周期的AI安全管理意识,形成以安全为导向的企业文化,为企业的可持续发展打下坚实基础。

- 竞争力增强:拥有具备CAISP认证的专家团队,企业能够在激烈的市场竞争中展现更高的安全标准和专业实力,吸引更多合作伙伴和客户信任。

CAISP学习对象

- AI行业相关人员:AI工程师与开发者、AI安全工程师、AI应用终端用户;

- 安全相关人员:安全研究员、合规与风险管理专员、网络安全从业者;

- 其他:政策制定者和监管机构、科技管理者、在校学生

CAISP课程大纲

| 模块 | 培训内容 |

| AI安全概述篇 | AI与AI安全基本概念AI与安全衍生技术发展脉络 |

| 技术基础篇 | 常见AI算法与模型介绍AI模型与算法安全性分析数据隐私保护与安全措施 |

| 安全风险篇 | 大模型安全风险概述典型攻击与应对策略:提示攻击、对抗攻击、梯度泄露攻击、推理攻击、模型萃取攻击、供应链攻击、应对策略防御机制解析 |

| 政策与治理篇 | 国内外AI安全法律法规、标准规范分析AI安全治理框架 |

| 全生命周期管理篇 | DevSecOps与AIAI安全需求分析与设计安全的AI系统开发指南与实践AI安全测评框架应用AI渗透测试技术与方法AI安全运营保障体系建设 |

| 标准与评估篇 | AI安全框架AI成熟度模型应用与评估AI安全标准与测评认证实践 |

| 特别篇ChatGPT的安全影响 | 恶意行为者利用LLM的安全分析防御者如何将LLM应用于网络安全恶意提示词攻击的防范措施企业安全使用ChatGPT的最佳实践 |

| 实践案例篇 | 现实世界中的AI安全问题深度分析解决方案制定与应对策略关键领域的AI安全最佳实践案例行业大模型应用及安全实践案例 |

| 伦理与未来发展 | AI伦理道德挑战与分析典型场景下的AI伦理道德风险未来发展趋势 |

| 考前串讲 | 考前要点讲解与考前练习 |