AI时代,7个热门网络安全新岗位来了! | AI相关认证

我们已经进入人工智能为主旋律的网络安全新时代,新的风险不断浮现,传统的安全岗位也在悄然“进化”,从以往单纯关注系统、网络和终端的“红队与蓝队”博弈,到如今需要与AI模型共舞,网络安全的角色版图正在重构。

本文将带你了解人工智能浪潮下正快速崛起的7个网络安全新岗位,并提供上岗前所需的关键技能指南。

AI渗透测试员

传统的渗透测试员专注于识别系统与网络中的漏洞,而AI渗透测试员的对手,则是算法本身。AI渗透测试专业人士必须理解对抗性机器学习技术,并能模拟攻击者如何欺骗AI模型,比如:

- 输入对抗样本误导模型判断;

- 投毒训练数据;

- 对模型进行反推还原等。

核心职责包括:

- 对AI模型执行“对抗性渗透测试”;

- 识别AI模型在提示注入(prompt injection)、数据投毒、模型漂移等方面的漏洞;

- 协同数据科学家提升模型抗攻击能力。

AI风险管理师

AI系统的“黑箱”属性令其具备独特的风险来源,例如算法偏见、输入数据污染、模型失效等。

AI风险管理师不仅要精通传统IT风险,更需熟悉NIST AI风险管理框架等行业规范。

核心职责包括:

- 识别AI系统特有的合规、伦理与操作风险;

- 出具AI系统风险评估报告;

- 建立AI生命周期中的风险应对机制。

AI安全数据科学家

数据科学家原本关注模型性能,如今也必须承担“模型安全官”的职责。

AI安全数据科学家专注于在训练阶段嵌入防御机制,以降低模型被攻击者利用的风险。

核心职责包括:

- 构建具备抗对抗攻击能力的模型架构;

- 分析数据流管线的安全性;

- 应用差分隐私、联邦学习等保护技术。

AI治理官

这类岗位正在被越来越多的大型组织设立,专责AI合规治理与伦理框架构建。

他们推动AI在企业内部的“安全落地”,包括制定规范、审查模型行为,以及协调法律与技术之间的断层。

核心职责包括:

- 制定AI内部控制与问责机制;

- 监督AI系统合规性与透明性;

- 组织AI行为定期审计。

AI伦理官

当AI模型参与风控、招聘、信贷等决策时,其公正性直接影响企业声誉和合规性。

AI伦理官负责“审问AI是否有偏见”,他们从人权与道德出发,审查AI的公平性和可解释性。

核心职责包括:

- 检测并修正AI模型中的算法偏见;

- 构建AI伦理标准并组织内部培训;

- 出具AI影响评估报告。

AI合规专员

面对快速完善中的AI法规,例如中国人工智能法规(《人工智能生成合成内容标识办法》、《生成式人工智能暂行管理办法》等)、欧盟AI法案(EU AI Act)、GDPR、CCPA等监管要求,AI合规专员成为企业数字化系统中不可或缺的一环。

他们不仅是“法律翻译官”,更是AI系统从模型设计到部署过程中风险把控的关键角色。

核心职责包括:

- 审查AI系统是否符合监管要求;

- 建立AI审计与记录留存机制;

- 追踪全球AI法规变化,动态调整策略。

AI安全专家

这是最贴近传统网络安全岗位的角色,但其专长在于识别AI模型本身的运行风险。

他们通常来自SOC(安全运营中心)或安全开发团队,负责应对AI系统在生产环境中的攻击、操控或滥用行为。

核心职责包括:

- 识别AI服务暴露面与攻击面;

- 实施AI系统访问控制与异常检测;

- 组织AI模型的定期安全测试与回滚机制。

如何准备这些岗位?

要在AI时代的安全岗位中脱颖而出,不仅要“懂安全”,更要“懂AI”。以下五个能力方向值得重点投资:

- 掌握AI与机器学习基础:理解算法如何运行,了解训练流程与模型生命周期;

- 数据科学与分析能力:会用Python、SQL分析数据安全风险;

- 对抗性思维与威胁建模能力:站在攻击者角度评估AI系统脆弱性;

- 熟悉AI伦理与法律法规:掌握EU AI Act、NIST框架等新兴规则;

- 了解云原生AI安全架构:熟悉在AWS、Azure、GCP上部署与保护AI模型。

- 获取权威AI安全认证:例如云安全联盟的权威认证CAISP(认证AI安全专家)或AI Foundation 认证。

CAISP

人工智能安全认证专家

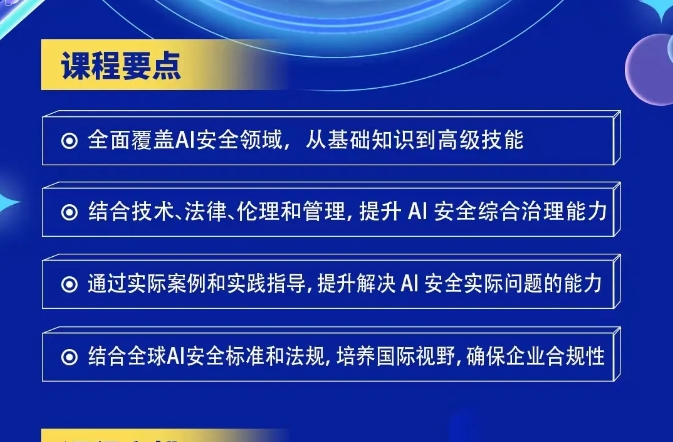

CAISP课程专注于理解人工智能安全的治理与管理环境,学习 AI 安全的术语与安全目标、针对于算法、模型以及数据安全和隐私进行学习,全面提升对 AI 安全风险的识别、评估与测评等实战化能力;课程还涵盖了 AI 安全的国内与国外的法律法规框架,并通过实际案例,探讨如何在组织中实施 AI 安全;此外,学员还将具体学习如何应对 AI 安全的风险与挑战,包括应对数据投毒、对抗性攻击和供应链威胁等多种安全挑战。

CAISP课程收益

对个人价值

- 技术与实战结合:通过实际案例和实践指导,提升解决实际问题的能力,将理论知识转化为实际操作技能,促进个人技术成长与实操经验积累。

- 国际视野拓展:结合全球AI安全标准和法规的学习,帮助个人形成国际化的视角,提升在跨国企业或国际合作项目中的适应性和价值。

- 法律法规精通:熟悉国内外政策法规,增强伦理道德意识,为个人职业生涯树立合规操作的基石,降低法律风险。

- 职业发展加速:获得CAISP认证,证明个人在AI安全领域的专业地位,有利于职业晋升、薪资增长以及更广泛的职业选择。

- 安全思维培养:从设计到运营的全周期安全管理能力,使得个人能够在任何涉及AI安全的项目中发挥关键作用,成为企业不可或缺的安全专家。

对企业价值

- 合规性保障:员工熟悉国内外AI安全政策和伦理道德,帮助企业建立合规的安全管理体系,避免法律风险,提升企业形象和社会责任感。

- 成本效率优化:通过DevSecOps的集成,提高AI开发流程的安全性与效率,减少因安全问题导致的修复成本和时间延误。

- 创新能力提升:在大语言模型安全实践与ChatGPT安全最佳实践的指导下,企业能够安全高效地利用最新技术,推动产品和服务创新。

- 安全化构建:培养员工在全生命周期的AI安全管理意识,形成以安全为导向的企业文化,为企业的可持续发展打下坚实基础。

- 竞争力增强:拥有具备CAISP认证的专家团队,企业能够在激烈的市场竞争中展现更高的安全标准和专业实力,吸引更多合作伙伴和客户信任。

CAISP学习对象

- AI行业相关人员:AI工程师与开发者、AI安全工程师、AI应用终端用户;

- 安全相关人员:安全研究员、合规与风险管理专员、网络安全从业者;

- 其他:政策制定者和监管机构、科技管理者、在校学生

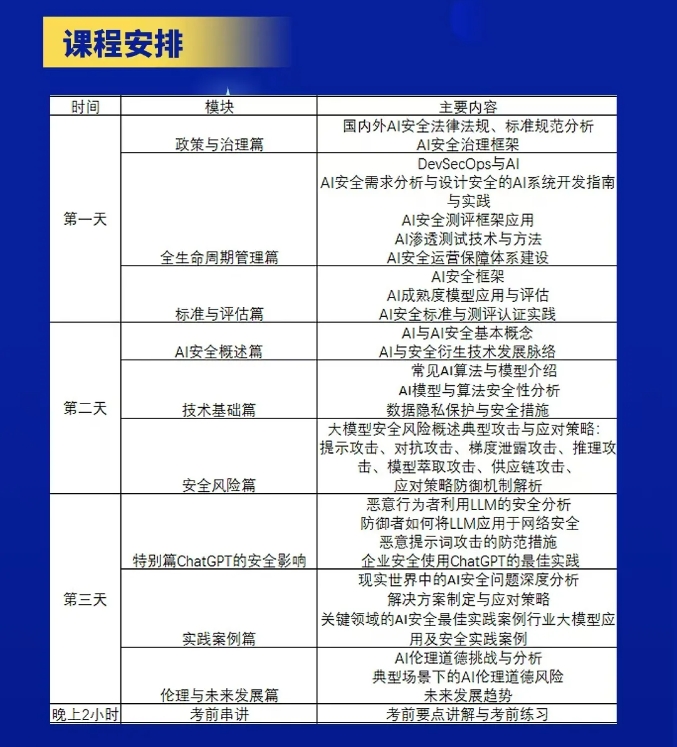

CAISP课程大纲

| 模块 | 培训内容 |

| AI安全概述篇 | AI与AI安全基本概念AI与安全衍生技术发展脉络 |

| 技术基础篇 | 常见AI算法与模型介绍AI模型与算法安全性分析数据隐私保护与安全措施 |

| 安全风险篇 | 大模型安全风险概述典型攻击与应对策略:提示攻击、对抗攻击、梯度泄露攻击、推理攻击、模型萃取攻击、供应链攻击、应对策略防御机制解析 |

| 政策与治理篇 | 国内外AI安全法律法规、标准规范分析AI安全治理框架 |

| 全生命周期管理篇 | DevSecOps与AIAI安全需求分析与设计安全的AI系统开发指南与实践AI安全测评框架应用AI渗透测试技术与方法AI安全运营保障体系建设 |

| 标准与评估篇 | AI安全框架AI成熟度模型应用与评估AI安全标准与测评认证实践 |

| 特别篇ChatGPT的安全影响 | 恶意行为者利用LLM的安全分析 防御者如何将LLM应用于网络安全恶意提示词攻击的防范措施 企业安全使用ChatGPT的最佳实践 |

| 实践案例篇 | 现实世界中的AI安全问题深度分析解决方案制定与应对策略关键领域的AI安全最佳实践案例行业大模型应用及安全实践案例 |

| 伦理与未来发展 | AI伦理道德挑战与分析典型场景下的AI伦理道德风险未来发展趋势 |

| 考前串讲 | 考前要点讲解与考前练习 |

CAISP证书样例

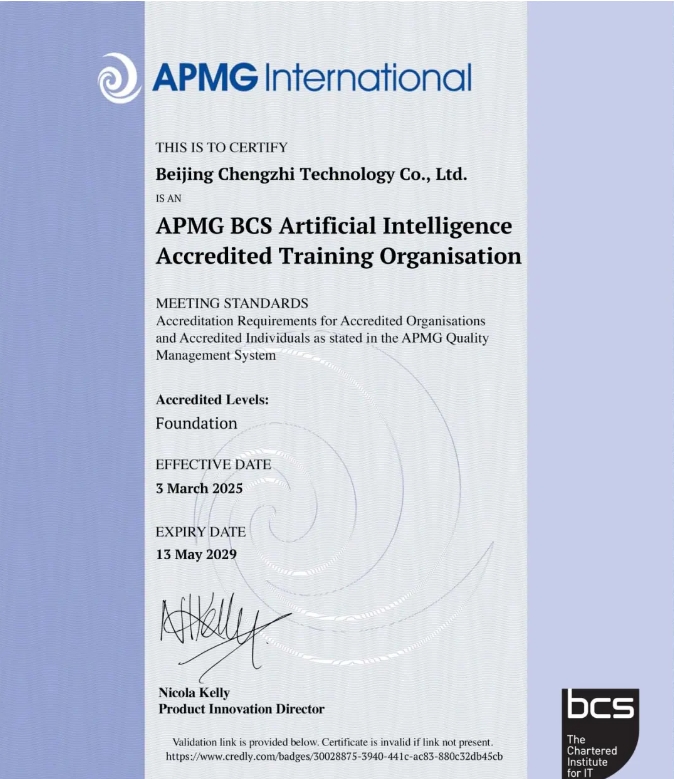

BCS AI Foundation 认证

人工智能(AI)是一种使用非人类系统从经验中学习和模仿人类智力行为的方法。英国计算机学会(BCS)人工智能基础证书考察考生对人工智能术语和一般原理的知识和理解。

本课程大纲涵盖了符合道德、可持续且可靠的人工智能的潜在优势和挑战;机器学习(ML)的基本过程——创建机器学习工具包;与人工智能项目相关的挑战和风险,以及人工智能和人类工作的未来。本基础证书包括并扩充了BCS AI基本证书中所教授的知识。

AI Foundation

首期班福利

承制科技首期AI Foundation 认证培训班即将开班,现在报名可享受首期班福利,山地自行车或动感单车二选一。

AI Foundation

适用人群

人工智能基础证书主要针对组织中对人工智能感兴趣(或需要开展AI项目)的个人,特别是从事科学、工程、知识工程、金融、教育或IT服务等领域工作的人员。

- 工程师

- 科学家

- 专业研究管理者

- 首席技术官

- 首席信息官

- 组织变革实践者和管理者

- 企业变革实践者和管理者

- 服务架构师和管理者

- 项目和计划经理

- 服务提供商组合策略师/潜在客户

- 流程架构师和管理者

- 企业策略师和顾问

- 网页开发人员

AI Foundation

课程大纲

| 课程大纲 | 培训内容 |

| 符合道德伦理和可持续的人类和人工智能(20%) | 人类和人工智能的一般定义 |

| 符合道德伦理和值得信赖的AI | |

| 可持续发展的三个基础领域 | |

| 联合国的17个可持续发展目标 | |

| 通用化设计和第四次工业革命 | |

| 机器学习和人工智能 | |

| 人工智能和机器人(20%) | AI智能体定义 |

| 机器人的概念 | |

| 智能机器人的概念 | |

| AI优势的应用 – 挑战和风险(15%) | 可持续性与AI的关系 |

| 人工智能的优势 | |

| 人工智能的挑战 | |

| AI项目的风险 | |

| AI项目 – 理论和实践(30%) | 通过数据、功能、软件和硬件学习 |

| AI智能体的功能 | |

| 人类和机器的管理、作用和责任(15%) | 人工智能促使人类和机器协同工作 |

| 人类与机器协同工作的未来方向 | |

| 敏捷项目所需的团队成员类型 |

AI Foundation

学习收益

通过考试的持证人员能够展示其对符合道德和可持续的人工智能应用的知识和理解:

- 以人为中心符合道德和可持续的人类和人工智能

- 人工智能和机器人

- AI优势的应用 – 挑战和风险

- 机器学习理论与实践——创建机器学习工具箱

- 人类和机器的管理、作用和责任 – AI的未来

AI Foundation

考试相关

共40道选择题,闭卷考试,时长60分钟。答对65%(及26道题)视为通过。

AI Foundation

证书样例

AI Foundation

证书有效期

- 终身有效,无需维持