2021年最危险的25个软件漏洞

MITRE近日发布了过去两年中最常见和最危险的25个软件漏洞列表(CWE TOP25)。

软件弱点是影响软件解决方案的代码、架构、实现或设计的缺陷、错误、漏洞,以及各种其他类型的错误,可导致运行软件的系统受到攻击。

MITRE使用从美国国家漏洞数据库(NVD)获得的2019年和2020年常见漏洞(CVE)数据(大约 27,000个CVE制定了TOP 25榜单。

据MITRE介绍,CWE TOP25软件漏洞排名的评分算法综合考量了漏洞的利用频率与其严重程度。

“这种方法提供了对当前在现实世界中看到的漏洞的客观观察,创建了基于公开报告的漏洞而不是主观调查和意见分析的严谨性基础,并使该过程易于重复。”

MITRE的2021年TOP 25漏洞是危险的,因为它们通常很容易发现,影响很大,并且在过去两年发布的软件中很普遍。

它们还可能被攻击者滥用以完全控制易受攻击的系统、窃取目标的敏感数据或在成功利用后触发拒绝服务(DoS)。

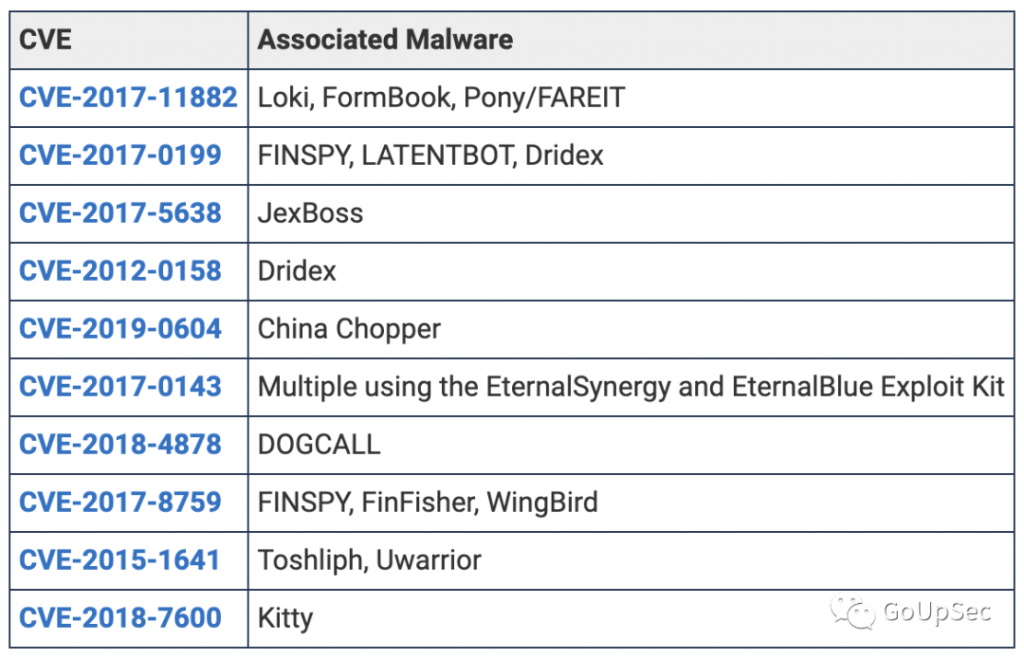

去年5月12日,美国网络安全和基础设施安全局(CISA)和联邦调查局(FBI)还公布了2016年至2019年间被利用最多的10大安全漏洞列表(下图)。

“CISA公布的十大安全漏洞TOP 10榜单中,最常被来自伊朗、朝鲜和俄罗斯等国家支持的网络黑客使用的三个漏洞是CVE-2017-11882、CVE-2017-0199和CVE-2012-0158。”CISA说:“这三个漏洞都与微软的OLE技术有关。”

参考资料

https://cwe.mitre.org/top25/archive/2021/2021_cwe_top25.html